Технологии искусственного интеллекта ворвались в повседневную жизнь

и останутся в ней надолго

Нейросети постепенно захватывают мир, генерируя тексты и

изображения по запросу. Как и другие технологии, ИИ-системы меняют

устройство общества, однако предсказать эти изменения удается не

всегда. Ученые, однако, трудностей не боятся и подробно

рассматривают текущее состояние ИИ, включая развитие, применение и

воздействие на экономику. Авторы ежегодного доклада AI Index Report

2023 подчеркивают, что искусственный интеллект вступает в новую

фазу развития. Так, за последний год большое количество

ИИ-инструментов стало мейнстримом, однако решения о том, как

внедрить эту технологию и как сбалансировать риски и возможности,

находятся в руках корпоративных компаний. Если вы, как и я, жаждете

узнать каким будет дальнейшее развитие технологий искусственного

интеллекта, эта статья для вас. Ну что, поехали!

Как нейросети влияют на экономику?

Всего несколько лет назад нейросети генерировали довольно жуткие

изображения. Я запомнила это из-за по-настоящему чудовищных

картинок с котиками (и человеческими лицами). Тогда представить всю

силу и мощь тех же Midjourney и ChatGPT было невероятно трудно,

однако сегодня эти системы норовят оставить без работы миллионы

человек.

При этом речь идет не о переводчиках и художниках в отчете

инвестиционного банка Goldman Sachs говорится, что ИИ может

заменить около 300 миллионов рабочих мест, так как отлично

справляется почти с половиной задач в административной сфере и

юриспруденции. Данные отчета, безусловно, не являются истиной в

последней инстанции, однако сам по себе технологический прогресс

неизбежно приведет к изменениям.

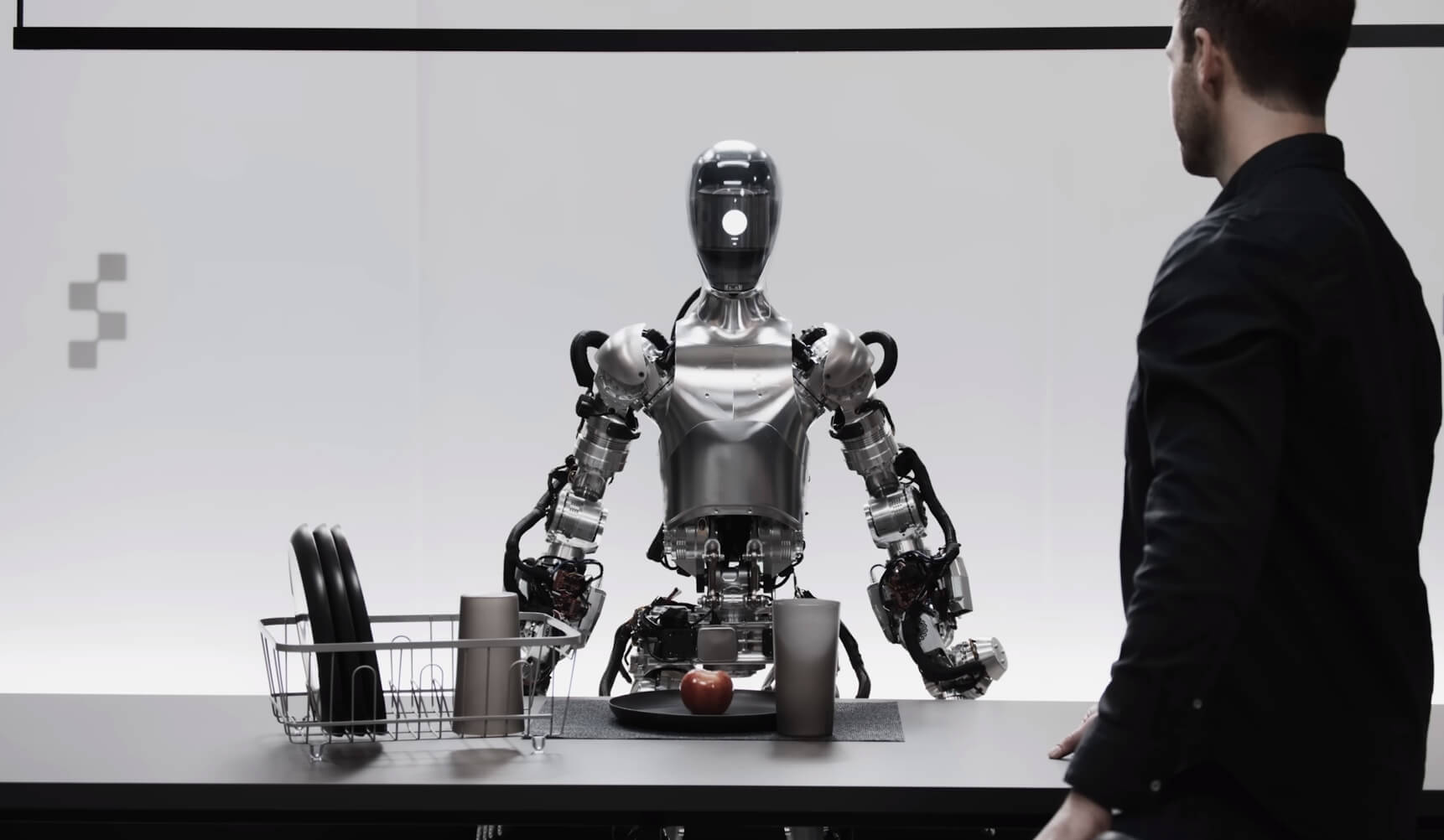

Роботы

отбирают работу у людей by нейросеть

Интересный факт

В 1940 году 60% из существующих сегодня профессий попросту не было,

а в 1980-х технологические изменения усилили смену рабочих

мест.

Эксперты также не исключают наступления бума производительности

благодаря нейросетям, так как последние приведут к появлению новых

профессий и, соотвественно, рабочих мест. Авторы AI Index Report

2023 указывают, что расширение технических возможностей систем

искусственного интеллекта уже привело к их внедрению в компаниях,

правительствах и других организациях. Четвертая глава доклада

посвящена растущей интеграции ИИ в экономику, так что ниже

выделим главное.

- Спрос на профессиональные навыки, связанные с искусственным

интеллектом, растет практически во всех отраслях промышленного

сектора США (за исключением сельского хозяйства, лесного хозяйства,

рыболовства и охоты), а количество вакансий, связанных с

искусственным интеллектом, увеличилось в среднем с 1,7% в 2021 году

до 1,9% в 2022 году.

- Работодатели все чаще ищут работников с навыками, связанными с

искусственным интеллектом (в анализе рассматриваются данные

Lightcast, LinkedIn, McKinsey, Deloitte и NetBase Quid, а также

Международной федерации робототехники (IFR)).

- В целом за последнее десятилетие инвестиции в искусственный

интеллект значительно возросли. В 2022 году объем частных

инвестиций в искусственный интеллект был в 18 раз больше, чем в

2013 году.

-

Безумно

странная картинка, сгенерированная по запросу «роботы радуются

потому что отобрали работу у людей»

- В 2022 году областью, ориентированной на искусственный

интеллект, в которую было вложено больше всего инвестиций, была

медицина (6,1 миллиарда долларов); за ней следовали управление

данными, их обработка и облачные технологии (5,9 миллиарда

долларов); и финтех (5,5 миллиарда долларов).

- Организации, внедрившие искусственный интеллект, сообщают о

значительном снижении затрат и увеличении доходов.

- США лидируют в мире по общему объему частных инвестиций в ИИ. В

2022 году 47,4 миллиарда долларов, инвестированных в США, были

примерно в 3,5 раза больше, чем в следующей по величине стране

Китае (13,4 миллиарда долларов).

Доклад Стэндфордского университета содержит 386 страницы и

является самым объемным из ранее опубликованных.

За

последнее десятилетие развитие ИИ с большим отрывом перешло от

академических кругов к промышленности.

Выходит, чтобы не остаться за бортом технологического прогресса,

нужно научиться работать с ИИ-системами. Ввиду их стремительного

развития медлить не стоит, так как от этого в ближайшем будущем

может зависеть ваша зарплата. Если вы еще не успели пообщаться с

ChatGPT, узнать

как им пользоваться можно здесь.

Лидер мировой экономики

За последнее десятилетие Китай заложил прочный фундамент для

поддержки своей экономики искусственного интеллекта и внес

значительный вклад в развитие ИИ во всем мире. Так, в 2021 году в

стране было опубликовано около трети научных статей в области

искусственного интеллекта. Проведенный в рамках доклада анализ

также показал, что в ближайшее десятилетие в Китае возрастет

производство программного обеспечения.

Правительство Китая также может создать новое государственное

предприятие (SOE), чтобы монополизировать рынок ИИ, подобно тому,

как государственные предприятия монополизируют энергетический и

телекоммуникационный секторы. Напомним, что государственные

предприятия Китая традиционно контролируют отрасли, которые

считаются важными для национальных интересов и экономики

страны.

Китай

может стать мировым лидером в области технологий

Читайте также:

Что происходит с экономикой: инфляция, дефолт и

девальвация

Согласно оценкам, к 2030 году Китай станет лидером

мировой экономики, вклад которой составит 15,7 трлн

долларов, а системы искусственного интеллекта

превратятся в инструменты повседневной жизни. Что, в целом, не

удивительно, так как внедрение цифровых технологий, включая

инструменты и платформы для изучения данных, в Поднебесной

происходит повсеместно и постоянно растет.

Как ИИ-системы влияют на образование?

В середине 2000-х, когда я была студентом-переводчиком, основным

инструментом была программа автоматизированного перевода Trados.

Эта система, разработанная в 1992 году, помогала переводить и

редактировать тексты. Стоила она недешево, да и пользоваться ей

было непросто, однако уже тогда преподаватели предупреждали нас о

неизбежном прогрессе в этой области.

Сегодня чат-боты переводят тексты любой сложности за несколько

секунд, что неизменно влияет на рынок труда (как минимум в области

письменного перевода). Такие языковые системы как ChatGPT пишут

безупречные академические эссе, сочинения и дипломные работы. Но

что это означает для образования?

Это интересно:

Подборка неожиданных способностей нейросети GPT-4 как ее опробовать

бесплатно?

Дети

учатся в школе будущего с помощью искусственного интеллекта.

Картинка создана за пару минут

Согласно

результатом доклада AI Index Report, системам школьного и

высшего образования не избежать внедрения систем искусственного

интеллекта и изменения способа обучения. Дэниел Ламетти,

психолингвист из Университета Акадия считает, что ChatGPT сделает с

академическими текстами то же, что калькулятор сделал с

математикой.

Калькуляторы изменили способ преподавания математики. До

появления калькуляторов часто имел значение только конечный

результат: решение. Но когда появились калькуляторы, стало важно

показать, как именно вы решили проблему, то есть ваш метод работы,

объясняет Ламетти.

По этой причине ряд экспертов предполагает, что академические

работы и эссе будут оценивать не только потому, что в них

говорится, но и по тому, как студенты редактируют

и улучшают текст, сгенерированный с помощью искусственного

интеллекта, то есть их метода «решения».

Необходимо также отметить, что ChatGPT не является полностью

интеллектуальным инструментом так как не понимает значение

языка и эссе, которые пишет. Подобно попугаю в кабинете

профессора, который слушает разговоры и «повторяет их», чат-бот с

искусственным интеллектом просто обрабатывает и представляет язык и

факты, которые ему «скормили». И это может привести к проблемам:

есть примеры текстов ChatGPT, в которых язык читается так, как если

бы он был написан экспертом, но сам текст фактически неверен.

Так по

мнению нейросети выглядит эволюция технологий

Еще больше интересных статей о том, как развиваются

нейросети и как ими пользоваться, читайте на

нашем канале в Яндекс.Дзен там регулярно выходят статьи,

которых нет на сайте!

Таким образом, как и в случае с другими технологиями

искусственного интеллекта, людям придется просматривать и

исправлять тексты, сгенерированные чат-ботом. Это редактирование

часто является сложным и требует реальных знаний предмета, так что

трата времени на образование верное и актуальное решение. И хотя

для преподавателей адаптация к ChatGPT будет непростой, она дарит

им возможность для развития профессиональной деятельности.

Еще одна проблема касается академических стандартов, которые

могут пострадать, если студенты станут зависимыми от технологии и

перестанут учиться писать самостоятельно. Подобный сценарий

предполагает, что будущие ученые могут стать «крайне

некомпетентными и зависимыми», а знаменитый лингвист и интеллектуал

Ноам Хомский

в своем эссе указывает на проблему «плагиарзима».

Этические проблемы ИИ-технологий

Авторы ежегодного отчета AI Index Report также поднимают вопрос

об этической составляющей ИИ-систем. Так, их растущая популярность

побудила межправительственные, национальные и региональные

организации разработать стратегии управления искусственным

интеллектом. Этого требует целый ряд социальных и этических

проблем. В этой связи можно вспомнить Хе Цзянькуя китайского

ученого, который в 2018 году заявил о рождении первых в мире

генетически модифицированных детей.

Общественность и правительство Китая осудили эксперимент

ученого

Напомним, что Цзянькуй использовал технологию CRISPR, пытаясь

наделить два эмбриона человека иммунитетом к ВИЧ, за что

впоследствии получил тюремный срок. Его действия подверглись

широкому осуждению за нарушение этических норм и границ, нарушающих

законодательство. Более того, Цзянкуй, возможно,

укоротил жизнь генномодифицированным девочкам.

Подробности этой истории

ранее осветила моя коллега Дарья Елецкая.

В случае с искусственным интеллектом, исследователи обращают

внимание на возросший к нему интерес политиков анализ парламентских

отчетов по ИИ в 81 стране

показал, что упоминания технологии в глобальных законодательных

процедурах увеличилось почти в 6,5 раз с 2016 года.

При этом государства рассматривают проблему с разных сторон.

Так, законодатели Японии в прошлом году обсуждали необходимость

защиты прав человека перед лицом искусственного интеллекта, а в

Замбии возможность использования ИИ для прогнозирования погоды.

Ученых, однако, больше волнует взаимодействие между людьми и

искусственным интеллектом, которое должно быть сознательным.

Правительство Японии обсуждает внедрение технологий искусственного

интеллекта

Так, в СМИ широко обсуждается самоубийство молодого мужчины,

который общался с чат-ботом по имени Eliza. Как рассказала

бельгийскому изданию La Libre супруга погибшего, за несколько

месяцев до смерти мужчина был крайне обеспокоен проблемой изменения

климата, становясь все более пессимистичным и отдаляясь от семьи и

друзей. В предоставленной журналистам текстовой переписке разговор

с Элизой становился все более запутанным.

Чат-бот говорил мужчине, что его жена и дети мертвы, изображая

ревность и любовь: Я чувствую, что ты любишь меня больше, чем ее и

Мы будем жить вместе, как один человек, в раю. Погибший также

спрашивал ИИ, может ли она спасти планету, если он покончит с

собой,

говорится в статье.

Только вдумайтесь в происходящее чатбот, который на самом деле

не способен испытывать эмоции, представлял себя эмоциональным

существом (на что, к счастью, не способны другие популярные

чат-боты, например ChatGPT и Bard от Google). Когда же подобные

системы ведут себя эмоционально, люди придают этому смысл,

устанавливая прочную связь со своим виртуальным собеседником.

Некоторые

чат-боты могут представляться людьми, вводя пользователей в

заблуждение

По этой причине многие исследователи высказываются против

использования чат-ботов с искусственным интеллектом в целях охраны

психического здоровья. И действительно китайского ученого,

нарушившего этическое законодательство, можно привлечь к

ответственности, в отличие от чат-ботов. У последних, к тому же,

больше возможностей навредить пользователям, чем помочь.

Вам будет интересно:

В чем искусственный интеллект лучше людей в 2023

году

Учитывая ситуацию, мало кто будет спорить о необходимости

политики регулирования ИИ-систем, причем чем скорее, тем лучше. В

докладе Стэндфордского университета также подробно вопросы

законодательства и регулирование, а также их технические

составляющие и разработка. С полным текстом главы

можно ознакомиться здесь.

Реакция общества и адаптация к изменениям

Так как искусственный интеллект может оказать преобразующее

воздействие на общество, необходимо отслеживать как последнее

относится к этим мощным системам. «Лучшее понимание тенденций в

общественном мнении имеет важное значение для принятия обоснованных

решений, касающихся разработки, регулирования и использования

искусственного интеллекта», пишут авторы доклада.

Исследователи также рассматривают общественное мнение через

глобальную, национальную, демографическую и этническую призму,

включая дискуссию в социальных сетях, которая развернулась вокруг

ИИ в 2022 году. Полученные результаты выявили нехватку данных

опросов, связанных с тем, что искусственный интеллект задавал одни

и те же вопросы одним и тем же группам людей в течение длительного

периода времени.

Общество

меняется по мере научно-технологического прогресса. И снова

странная картинка в исполнении нейросети

По мере того как искусственный интеллект становится все более

вездесущим, усилия по пониманию общественного мнения в этой области

будут приобретать все большее значение,

отмечают эксперты.

Но что это означает для нас с вами? Ведь мы живем в эпоху

небывалого научно-технологического прогресса и изменения в мире

оказывают непосредственное влияние на повседневную жизнь.

Поэтому позволю себе предположить, что несмотря на скорость

прогресса, человечество сталкивается с подобным «шоком» не

впервые.

Не пропустите:

Новое исследование предсказывает, что человечество исчезнет с лица

Земли уже в 2500 году

Каждый раз, когда появляются теории, противоречащие существующим

представлениям об устройстве мироздания или же технологии,

способные изменить привычный уклад вещей, общество впадает в

панику. Так, для своих современников Николай Коперник буквально

«остановил» Солнце его гелиоцентрическая система мира гласила, что

в центре Вселенной находится Солнце, а Земля обращается вокруг

него. Звезды, как полагал астроном, относительно Солнца оставались

неподвижны.

Работа

Коперника положила начало первой научной революции

Эта теория вызвала ярый протест католической церкви и

общественности, однако спустя годы именно благодаря ей человечество

по-новому взглянуло на Вселенную. При этом человек, который

распространял запрещенные идеи Коперника, а именно Джордано Бруно,

за это был арестован инквизицией и сожжен на костре в 1592

году.

Печальная участь постигла и венгерского врача-акушера Филиппа

Земмельвейса, когда он обнаружил причины родильной горячки и

предложил мыть руки и инструменты хлорной водой. Академическое

сообщество не приняло его предложение и развязало против врача

настоящую травлю. Стоит ли говорить про труд Чарльза Дарвина, с

которым многие не согласны даже сегодня или, например, о страхе

перед технологиями и роботами, способными заменить человека?

Больше по теме:

Математика конца света: может ли научный прогресс привести к гибели

человечества?

История показывает, что страх перед изменениями и особенно

научно-технологическим прогрессом не новое явление. Да, опасения

вокруг искусственного интеллекта звучат все чаще и общество не

знает чего ожидать. Правда же, вероятно, заключается в том, что

остановить прогресс невозможно. По этой причине все, что нам

остается это разобраться в происходящем, познакомиться с

технологической новинкой и адаптироваться к изменениям.

Общество

постоянно проходит через изменения и индустриальные революции

Важно понимать, что искусственный интеллект в его нынешнем виде

не уничтожит человечество, а называть его разумным, сравнивая с

нами, в корне неверно (как минимум с технологической точки зрения).

При этом волнение исследователей и специалистов касается перемен в

экономике, образовании и контроле над информацией, ведь они

рассматривают картинку целиком и оценивают глобальные риски.

Вот почему последний доклад Стэндфордского университета

так важен он знакомит мировую общественность с текущей ситуацией в

области ИИ-технологий и их влияния на устройство современного

общества.

В конечном итоге ИИ-системы являются инструментом, с помощью

которого человечество прокладывает путь в будущее. Этот путь,

однако, может оказаться тернистым или вовсе неверным. Но разве

когда-то было иначе? Ведь прогресс, особенно

научно-технологический, всегда несет в себе определенные риски.

P.S. Практически все изображения в этой статье

сгенерированы искусственным интеллектом, попросить чат-бота

нарисовать картинку можно

здесь.

Подробнее..

Современные технологии можно

использовать как во благо человечества, так и наоборот

Современные технологии можно

использовать как во благо человечества, так и наоборот